Может ли программа выявить сложные черты личности, просто проанализировав лицо человека, например, на фотографии? Сотрудники Faception, компании, основанной в Израиле, инициировали дискуссию вокруг этой темы, заявив, что их техника способна на это.

Более того, по их утверждению, технология позволяет не просто разделить людей по банальным категориям – интроверт, экстраверт. Она может обнаружить террористов, педофилов и других социально опасных людей.

Алгоритм Faception исследует изображения человека, полученные из разных источников, включая загруженные фотографии, видео и снимки из базы данных. Затем хитроумный Faception высчитывает численные параметры черт, включая соотношение ширины и высоты разных частей лица, отмечает для себя другие ключевые параметры. Например, как расположены уголки глаз и рта.

Но всё это, можно сказать, стандартная процедура. «Использование автоматизированной «экстракции» является обычной мерой для распознавания лица и эмоций», — поясняет Райя Хэдселл (Raia Hadsell), инженер машинного зрения в подразделении Google DeepMind.

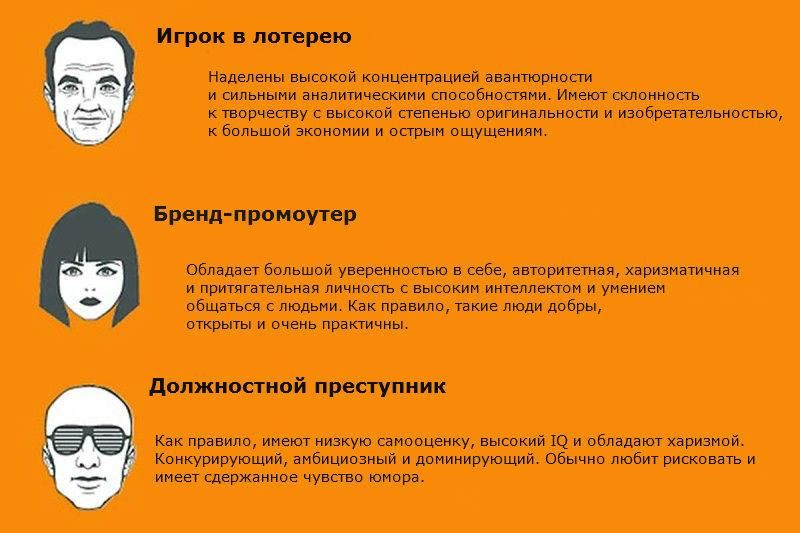

А вот то, как дальше работает программа, вызывает нарекания у экспертов. Отмечается, что Faception затем классифицирует лица в 15 групп, которые израильские учёные разработали за последние три года. Категории включают в себя террориста, педофила, должностного преступника, игрока в покер, игрока в лотерею и академика.

По словам директора по технологиям Faception Ицика Вильфа (Itzik Wilf), для того чтобы придумать эти нестандартные архетипы, они тренировали систему на общих чертах лиц с тысяч изображений известных людей всех категорий.

Подчеркивается, что программное обеспечение обращает внимание только на черты лица и игнорирует такие особенности, как причёска или украшения.

Вильф добавляет, что это привело к заметным успехам в работе: при представлении программе фотографий 11 людей, стоящих за терактами в Париже в 2016 году, алгоритм классифицировал девять из них как террористов. Аналогичным образом он вычислил 25 из 27 игроков в покер по базе данных изображений.

Сотрудники Faception также рассматривают и более прозаичное использование своей новой технологии — в маркетинге и рекрутинге, или подборе персонала. «Кадровые службы могут использовать эту технологию для поиска подходящих кандидатов», — говорит Вильф, отмечая, что алгоритм может классифицировать людей в те или иные категории примерно с 80-процентной точностью.

Но многие исследователи машинного зрения считают это нечестной игрой. Так, по мнению Джея Туркота (Jay Turcot) из компании Affectiva, технология имеет серьёзные недостатки. «Что такая программа скажет о людях, которые имеют тот же возраст, пол, волосы на лице, как и террористы в Париже? Как много ложных утверждений выдаст такой алгоритм?». И действительно, цена ошибки высока — пока спецслужбы разберутся в невиновности человека, его жизнь может радикально измениться. Не говоря уже о том, что может быть потеряно время, и настоящий преступник успеет скрыться.

В ответ на такую критику Вильф замечает, что всегда есть вопросы к точности работы таких алгоритмов. По этой причине программа никогда не будет работать сама по себе и ставить «диагнозы» — окончательный вывод всегда будет за человеком.

В последние годы технология распознавания лиц находится в центре вниманий многих дискуссий. Так, совсем недавно обсуждалась тема вокруг российского приложения FindFace, которое подбирает идентификационные данные из социальной сети ВКонтакте. С её помощью пользователи могут найти людей, которых они встретили на улице, то есть простых прохожих. Понятно, что приложением могут воспользоваться не только спецслужбы, но и преступники.

Впрочем, по словам Вильфа, их компания не собирается сотрудничать с теми, кто намерен использовать технологию для таких целей. «Это новая идея, а новые идеи часто встречают с опаской», — заключает он.

Автор: Евгения Ефимова